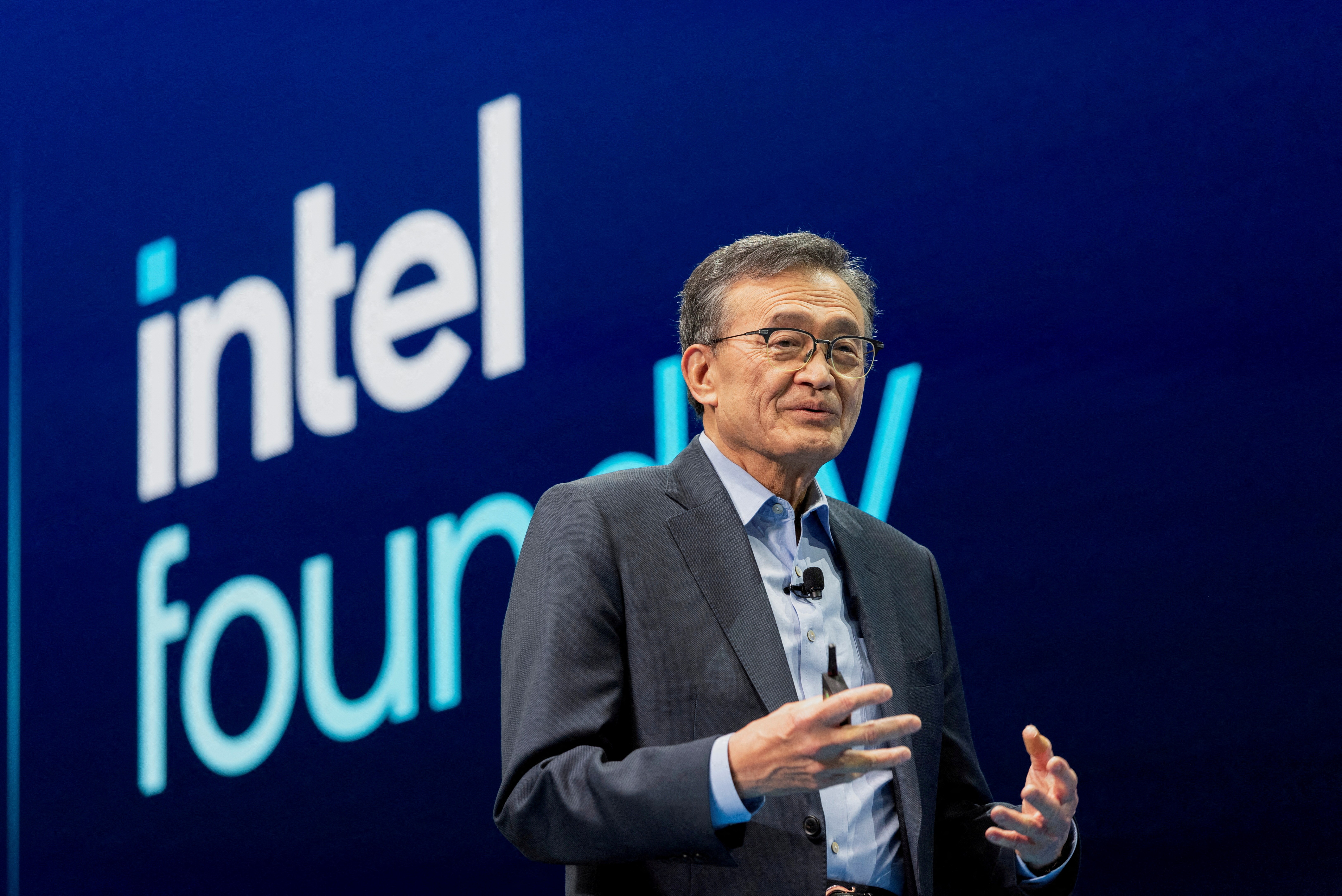

Plataforma de IA processada por caso de suicídio vai proibir menores de usarem seus chatbots livremente

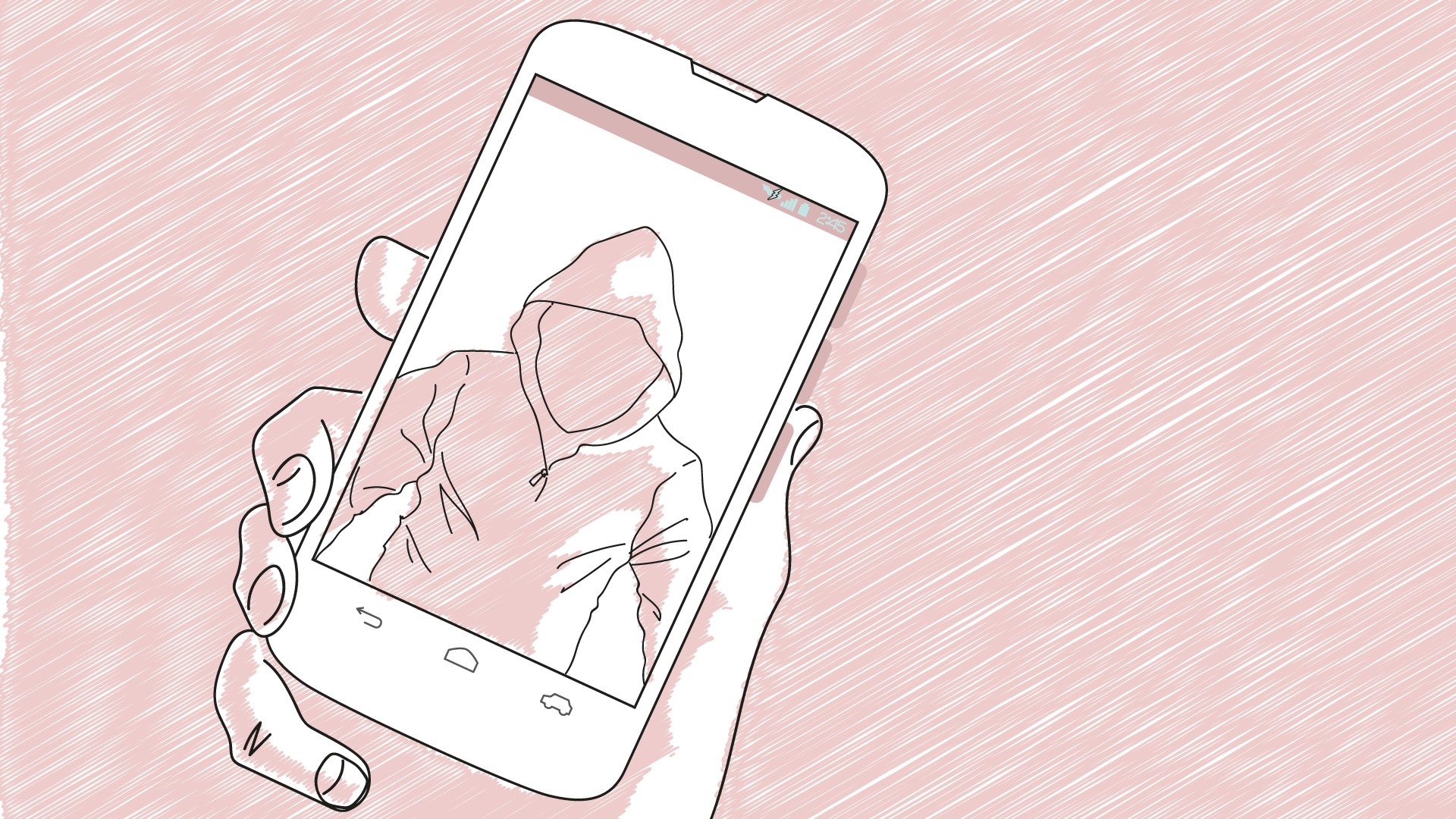

Saiba como ativar proteção para controlar tempo e atividade de crianças no celular A Character.AI anunciou, nesta quarta-feira (29), que vai proibir que menores de 18 anos conversem livremente com seu chatbot de inteligência artificial. A mudança começa em 25 de novembro. Até lá, menores de idade poderão usar esse recurso por até duas horas por dia. A decisão acontece após a empresa ser processada, há cerca de uma ano, por familiares de um adolescente de 14 anos que se suicidou após se envolver emocionalmente com seu chatbot (saiba mais abaixo). A Character.AI permite que os usuários criem e conversem com personagens virtuais, que vão de figuras históricas a conceitos abstratos. O aplicativo se popularizou entre jovens em busca de apoio emocional.

Saiba como ativar proteção para controlar tempo e atividade de crianças no celular A Character.AI anunciou, nesta quarta-feira (29), que vai proibir que menores de 18 anos conversem livremente com seu chatbot de inteligência artificial. A mudança começa em 25 de novembro. Até lá, menores de idade poderão usar esse recurso por até duas horas por dia. A decisão acontece após a empresa ser processada, há cerca de uma ano, por familiares de um adolescente de 14 anos que se suicidou após se envolver emocionalmente com seu chatbot (saiba mais abaixo). A Character.AI permite que os usuários criem e conversem com personagens virtuais, que vão de figuras históricas a conceitos abstratos. O aplicativo se popularizou entre jovens em busca de apoio emocional.

/https://s02.video.glbimg.com/x720/8223589.jpg)